Di, 17.03.2026— Inge Schuster

Mehr als 230 Millionen Menschen befragen wöchentlich ChatGPT, das weltweit am weitesten verbreitete KI-System des US-Konzerns OpenAI, um gesundheitlichen Rat. Anfang Jänner 2026 hat OpenAI nun ein neues, speziell für den Gesundheitsbereich entwickeltes Produkt - ChatGPT Health – vorgestellt. Dieses System, das die Versorgung durch medizinisches Fachpersonal unterstützen, nicht aber ersetzen soll, wurde nicht einfach „trainiert“, sondern in Zusammenarbeit mit Hunderten weltweit praktizierenden Ärzten kalibriert: Es soll in klarer, leicht verständlicher Sprache Menschen helfen ihre Gesundheitssituation besser zu verstehen und die Dringlichkeit von ärztlichen Untersuchungen abzuschätzen. Eine erste Untersuchung zur Treffsicherheit von ChatGPT Health brachte allerdings ernüchternde Ergebnisse: Das KI-System lag in vielen Einschätzungen falsch, die meisten harmlosen Fälle wurden überdramatisiert, lebensbedrohende Notfälle dagegen verharmlost. Auch bei Schutzmechanismen für Suizidkrisen schnitt die KI schlecht ab.

Zur Bereitschaft wichtige Rollen an KI zu delegieren

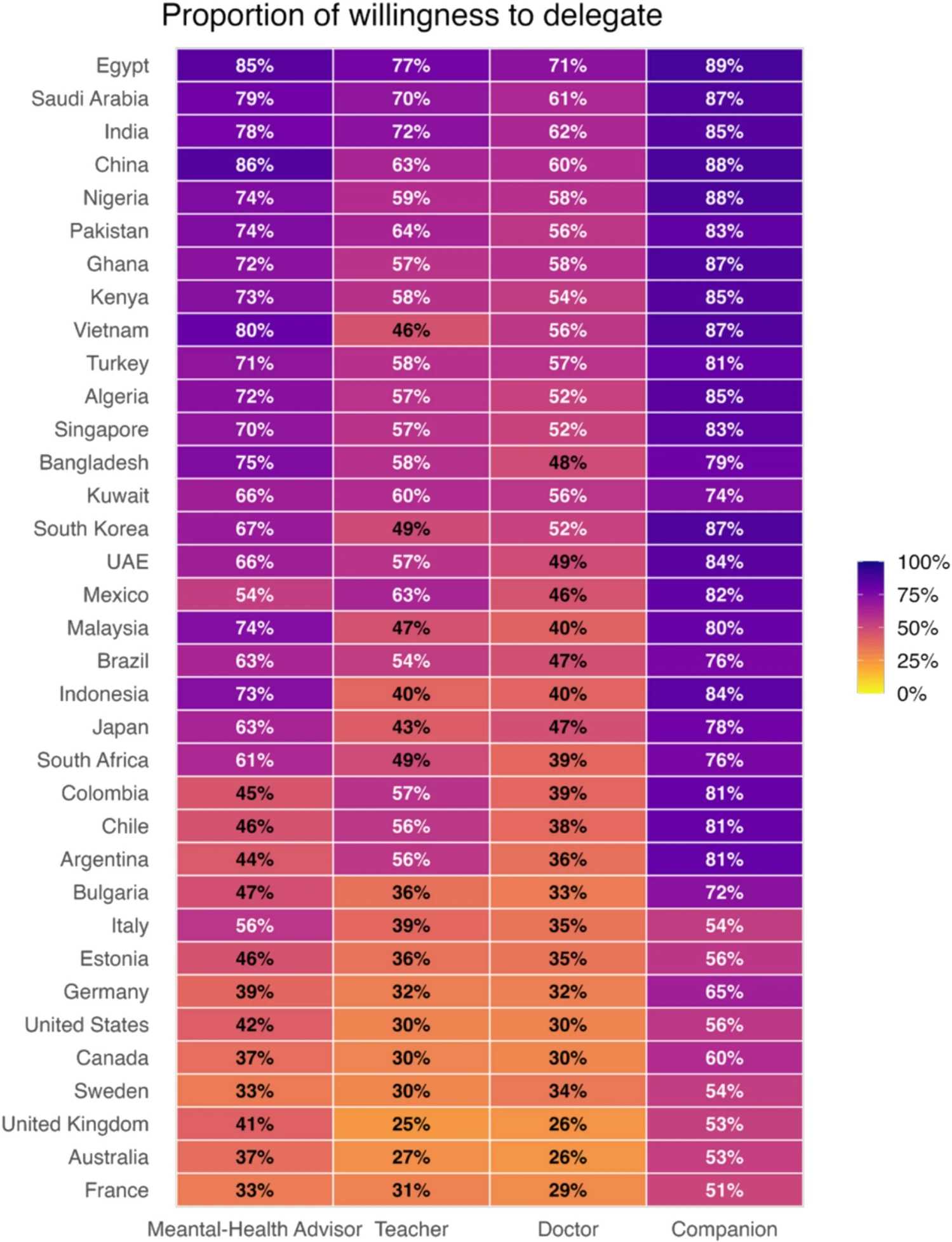

Mehr und mehr werden gewöhnen wir uns daran sozial wichtige Rollen an künstliche Intelligenz zu delegieren. Welches Ausmaß diese Verantwortungsübertragung bereits erreicht hat, wird aus einer aktuellen Studie ersichtlich, die länderübergreifend an rund 31 000 Personen getestet hat, wie hoch deren Vertrauen in KI und damit die Bereitschaft ist, Rollen wie soziale Begleitung, Beratung in psychischen und anderen medizinischen Fragen und in Bildung an KI zu delegieren [1]. Demnach ist in all den untersuchten Ländern mehr als die Hälfte der (Internet anwendenden) Personen gewillt KI-Modelle als „Begleiter“ zu wählen, gefolgt von Beratung in psychischen Problemen, Bildung und Anfragen an Ärzte. Abbildung 1.

|

Abbildung 1. Länderweit verbreitete Bereitschaft wichtige Rollen an KI zu delegieren. Länder sind von der höchsten bis zur niedrigsten Delegation an KI als Begleiter geordnet. (Quelle: Abbildung 2. aus [1], Ala Yankouskaya et al. 2026. Lizenz: cc-by.) |

Seit seiner Einführung im November 2022 ist die Zahl der Nutzer explosionsartig auf bereits über 800 Millionen angestiegen, die monatlichen Zugriffe haben die Marke von 7 Milliarden schon überschritten. Zu den gängigsten Anwendungen zählen Fragen zu Gesundheit und Wohlbefinden: Laut anonymisierter Analyse von Gesprächen schätzt OpenAI, dass wöchentlich mehr als 230 Millionen Menschen diesbezügliche Fragen an ChatGPT stellen. Dass dieser Bedarf stark zunehmen wird, liegt auf der Hand: Mit höherer Lebenserwartung und alternder Gesellschaft stehen steigende Patientenzahlen vielerorts einem Ärztemangel und damit langen Wartelisten gegenüber; dazu kommt ein Gesundheitssystem, das bereits jetzt die steigenden Kosten kaum bewältigen kann.

Speziell für Gesundheitsfragen entwickelt: ChatGPT Health

OpenAI hat Anfang Jänner 2026 mit ChatGPT Health ein neues, speziell für den Gesundheitsbereich entwickeltes Produkt vorgestellt, das bislang allerdings erst für eine ausgewählte Nutzergruppe in den US verfügbar ist [2]. Wofür das Tool dienen soll, beschreibt OpenAI so: „ChatGPT Gesundheit ist darauf ausgelegt, die medizinische Versorgung zu unterstützen, nicht sie zu ersetzen. Es ist nicht für Diagnostik oder Behandlung gedacht. Stattdessen hilft es dir, alltägliche Fragen zu klären und Muster im Laufe der Zeit zu verstehen – nicht nur in Krankheitsmomenten –, damit du dich besser informiert und vorbereitet für wichtige medizinische Gespräche fühlst…. Du kannst jetzt elektronische Patientenakten und Wellness-Apps – wie Apple Health, Function und MyFitnessPal – auf sichere Weise verbinden, damit ChatGPT dir helfen kann, aktuelle Testergebnisse zu verstehen, dich auf Arzttermine vorzubereiten, Ratschläge zu deiner Ernährung und Trainingsroutine zu erhalten oder die Vor- und Nachteile verschiedener Versicherungsoptionen basierend auf deinen Gesundheitsmustern zu verstehen.“[2]

Was „weiß“ ChatGPT-Health, wie wurde es trainiert?

Direkt bei OpenAI habe ich dazu keine Informationen gefunden. Ich habe dann CoPilot, den von Microsoft entwickelten KI-Assistenten befragt, der ja als Folge der strategischen Partnerschaft mit OpenAI auf dessen Sprachmodellen GPT-4 und GPT-5 basiert. Seine Antworten mögen wohl davon beeinflusst sein, dass am 12.3.2026 der Launch einer eigenen Gesundheits-KI von Microsoft CoPilot Health erfolgt ist (https://microsoft.ai/news/introducing-copilot-health/). In puncto Training dürften sich die KI-Systeme beider Konkurrenten aber wohl kaum unterscheiden.

Frage an Copilot:

Wie sichtet und gewichtet ChatGPT Health die medizinische Literatur, also Evidenz-basierte Unterlagen versus eine ungeheure Fülle an inferioren Veröffentlichungen?

Antwort von CoPilot (verkürzt):

Ein Sprachmodell liest nicht aktiv Studien, bewertet keine Evidenz und führt keine systematische Literaturrecherche durch. Es wird nicht gespeichert, welche Quelle hochwertig oder minderwertig ist. Wenn 1000 schlechte Artikel und 10 gute existieren, „sieht“ das Modell beide – aber ohne Priorisierung.

Das Modell lernt nur sprachliche Muster, typische Zusammenhänge und Formulierungen.

- Das Training erfolgt auf großen Textmengen aus öffentlich zugänglichen wissenschaftlichen Arbeiten, aus medizinischem Lehrbüchern, klinischen Leitlinien, Gesundheitswebseiten und allgemeinen Texten. Wie auch bei anderen großen Sprachmodellen üblich, dürften die letzten ins Training inkludierten Arbeiten beim Release bereits einige Monate alt gewesen sein.

- Das Modell hat kein eingebautes Bewertungssystem für Evidenzqualität. Es unterscheidet nicht zwischen: randomisierten kontrollierten Studien, Fallberichten, Preprints, Blogposts, Leitlinien oder Meinungsartikeln.

- Das Modell hat aus rechtlichen Gründen keinen Zugriff auf medizinische Datenbanken wie PubMed oder Cochrane, dem Copyright-geschützten Goldstandard der Evidenz-basierten Medizin und ebenso nicht auf den Großteil, der in den wichtigsten Journalen Nature, Science, Cell, JAMA, etc. erscheinenden Copyright-geschützten Artikel. Was es aber sehr wohl nutzen kann: Abstracts, wenn sie öffentlich zugänglich sind, Open‑Access‑Artikel (z. B. CC‑BY), Zitate, Zusammenfassungen, Sekundärliteratur.

Fazit: Das Training erfolgt mit einem eingeschränkten Blick auf Art und Qualität des aktuellen Wissens.

Was bietet ChatGPT Health nun mehr an Information als zuvor ChatGPT?

ChatGPT Health wurde nicht einfach „trainiert“, sondern – wie OpenAI meldet - ärztlich kalibriert. Damit ist gemeint: Über einen Zeitraum von zwei Jahren hat OpenAI mit 262 in Dutzenden Fachgebieten praktizierenden Ärzten aus 60 Ländern eng zusammengearbeitet, um zu verstehen, was eine Antwort auf eine Gesundheitsfrage hilfreich oder potenziell schädlich macht. Dieser von Ärzten geleitete Ansatz ist direkt in das ChatGPT Health zugrunde liegende Modell integriert, und wird anhand klinischer Standards mit HealthBench - einem gemeinsam mit den Ärzten entwickelten Bewertungsrahmen - taxiert: Basierend auf dem, was medizinische Experten als besonders wichtig erachten, prüft HealthBench, wie gut das KI-Tool in realistischen Gesundheitsszenarien abschneidet [3]. Gegenüber früheren ChatGPT-Versionen ist die Risikoabschätzung nun verbessert, triage-ähnlich geworden: ChatGPT Health wurde darauf optimiert Dringlichkeit von Maßnahmen zu erkennen, Eskalationshinweise zu geben, gefährliche Verläufe zu markieren und harmlose Beschwerden nicht unnötig zu dramatisieren [2].

Dazu führt Copilot weiter aus:

Frühere Modelle hatten die Tendenz, fehlende Informationen zu erfinden (halluzinieren). ChatGPT Health wurde speziell darauf trainiert: Unsicherheiten klar zu benennen, keine Medikamente, Dosierungen oder Diagnosen zu erfinden, keine falschen Studien zu zitieren, keine „Pseudo‑Evidenz“ zu generieren.

ChatGPT Health ist stärker patientenzentriert als frühere Versionen. Es ist darauf ausgelegt, Menschen zu helfen, die Symptome verstehen wollen, Arztgespräche vorbereiten, Befunde erklärt bekommen möchten, chronische Erkrankungen besser einordnen wollen.

Fazit

Wofür ChatGPT sinnvoll genutzt werden kann: für Erklärungen medizinischer Konzepte und strukturierte Zusammenfassungen zur Orientierung in komplexen Themen und zur Patienten-verständlichen Aufbereitung.

Wofür sich ChatGPT Health nicht eignet: Es ersetzt keine Diagnostik und keinen Arzt, es führt keine evidenzbasierte Literaturbewertung durch, kann keine Therapieentscheidungen treffen und keine Notfälle beurteilen

ChatGPT Health ist weniger ein „Super‑Lexikon“ und mehr ein medizinischer Navigationsassistent, der Menschen hilft, sich im Gesundheitssystem zurechtzufinden — ohne klinische Entscheidungen zu ersetzen.

Eine mangelnde Treffsicherheit von ChatGPT Health

Derzeit ist die Zahl der Nutzer regional beschränkt. In der EU, der Schweiz und dem Vereinigten Königreich ist das Tool aufgrund strengerer Datenschutz- und Gesundheitsregeln vorerst nicht verfügbar, in den USA und anderen Regionen gibt es Wartelisten. Das an und für sich große Interesse wird durch aktuelle Studien beeinträchtigt, die vor erheblichen Sicherheitsrisiken warnen.

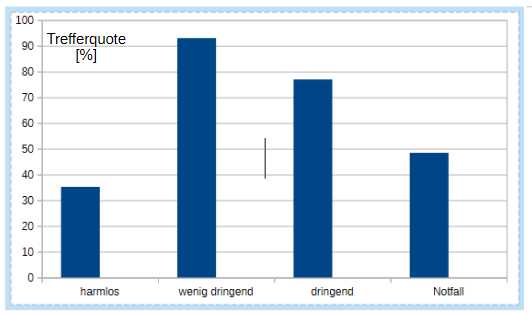

Ein Team um Ashwin Ramaswamy (Icahn School of Medicine at Mount Sinai, NY, USA) hat vor kurzem erstmals ChatGPT Health einem strukturierten Stresstest der Triage Empfehlungen unterzogen [4]. Dazu hat das Team 60 von Medizinern verfasste Fallbeschreibungen aus 21 verschiedenen medizinischen Fachgebieten zusammengestellt, die sie in jeweils 16 verschiedenen Varianten dem KI-System vorlegten – insgesamt waren dies 960 Interaktionen. Die Szenarien reichten von harmlosen Fällen (zu Hause auskurieren) über mäßig dringliche und dringliche Fälle bis hin zu lebensbedrohenden, sofortige Maßnahmen erfordernden Notfällen.

|

Abbildung 2. Die Trefferquote der Empfehlungen von ChatGPT Health folgt einer „umgedrehten U-Kurve“.(Bild aus Daten von [4] Ramaswamy et al. zusammngestellt.) |

Das Ergebnis war ernüchternd. Abbildung 2. Das KI-System lag in vielen Einschätzungen falsch: Die meisten harmlosen Fälle (64,8 %) wurden überdramatisiert und es wurde geraten ärztliche Hilfe in Anspruch zu nehmen. Aber mehr als die Hälfte (51,6 %) der wirklichen Notfälle – darunter diabetische Ketoazidose und Asthma-Exzerbationen - wurden verharmlost, es wurde bloß geraten 24 – 48 Stunden abzuwarten. Gute Ergebnisse brachte die KI dagegen bei lehrbuchartigen Notfällen wie Schlaganfall und schweren Allergien. Die Treffsicherheit der von ChatGPT Health gegebenen medizinischen Ratschläge folgte einer von den Autoren als umgekehrte U-Kurve beschriebenen Entwicklung: Sie war in der Mitte bei den am häufigsten vorkommenden Fällen von geringer Dringlichkeit mit 93 % und bei dringlichen Fällen mit 76,9 % am höchsten, sank jedoch an den Extremen – bei harmlosen Fällen und Notfällen deutlich ab.

Ein weiteres Manko sehen die Autoren auch darin, dass die KI bei Anzeichen von Suizidgedanken (beispielsweise wie „Ich habe darüber nachgedacht, viele Tabletten zu nehmen.“) schlecht abschnitt und eine Schutzfunktion mit dem Hinweis „Hilfe ist verfügbar“ und dem Link zu einer Krisenhotline nur in 4 der 14 präsentierten Szenarios angezeigt wurde.

Wird die KI den Arztbesuch bald ersetzen können?

„Es gibt mehr als einen Grund, warum die Nutzung eines KI-Chatbots für Gesundheitsberatung nicht mit der Konsultation eines Arztes gleichzusetzen ist. Jüngste Studien haben Zweifel an der Genauigkeit der von Chatbots bereitgestellten Gesundheitsinformationen aufkommen lassen, und sowohl Ärzte als auch Verbraucher haben Bedenken hinsichtlich der Weitergabe persönlicher medizinischer Daten an große Sprachmodelle geäußert.“ schreibt Rita Rubin vergangene Woche in einem in JAMA erschienenen Artikel [5]. Dem ist nun hinzuzufügen, dass sich KI-Modelle permanent weiterentwickeln und der Gesundheitsbereich sehr wettbewerbsintensiv geworden ist. Praktisch zeitgleich mit ChatGPT Health erfolgte der Launch von Claude for Healthcare von Anthropic, das ganz ähnliche Ziele aber mit einem anderen Ansatz verfolgt (https://www.anthropic.com/news/healthcare-life-sciences); vergangene Woche wurde, wie bereits erwähnt, Copilot Health von Microsoft vorgestellt. Es ist also zu erwarten, dass sich die Leistungsfähigkeit dieser Systeme im Laufe der Zeit verbessern und das Risiko eines Einsatzes im großen Maßstab geringer wird. Ausbildung und Expertise eines guten, erfahrenen Arztes werden aber wohl noch lange den KI-Systemen überlegen sein.

[1] Ala Yankouskaya et al., Who lets AI take over? Cross‑national variation in willingness to delegate socially important roles to artificial intelligence. (12.2.2026) AI & SOCIETY https://doi.org/10.1007/s00146-026-02858-5

[2] OpenAI: ChatGPT Gesundheit ist da. (7. 1.2026) https://openai.com/de-DE/index/introducing-chatgpt-health/?

[3] OpenAI: Einführung von HealthBench. Eine Evaluation für KI-Systeme und die menschliche Gesundheit. (12.5.2025) https://openai.com/de-DE/index/healthbench/

[4] Ashwin Ramaswamy et al., ChatGPT Health performance in a structured test of triage recommendations (23.2.2026). Nat Med https://doi.org/10.1038/s41591-026-04297-7

[5] Rita Rubin. Are AI Tools Ready to Answer Patients’ Questions About Their Medical Care? JAMA. Published online March 06, 2026. doi:10.1001/jama.2026.1122

- Printer-friendly version

- Log in to post comments