Do, 26.04.2018 - 07:38 — Francis S. Collins

![]()

Die Mikroskopie ist eine zentrale Methode in den Biowissenschaften. Um damit zelluläre Details erkennen und verfolgen zu können, müssen diese üblicherweise chemisch markiert (= gefärbt) werden - Verfahren, die zu Schädigungen der Zelle führen können. Eine Zusammenarbeit von Steve Finkbeiner (UCSF und Gladstone Institutes) und Google Accelerated Science Team [1] zeigt nun, dass Computer trainiert werden können ("deep learning"), sodass sie auch in unbehandelten Zellen Details erkennen, die weit über die Möglichkeiten menschlicher Beobachtung hinaus gehen. Francis Collins, NIH-Direktor und ehem. Leiter des "Human Genome Project", berichtet über diese bahnbrechenden, NIH-unterstützten Untersuchungen.*

Seit Jahrhunderten sind Wissenschaftler darauf trainiert, Zellen durch Mikroskope zu betrachten und ihre strukturellen und molekularen Merkmale gründlich zu untersuchen. Die langen Stunden, die so - über ein Mikroskop gebeugt - in der Betrachtung winziger Bilder verbracht werden, könnten allerdings in naher Zukunft nicht mehr erforderlich sein. Zelluläre Merkmale zu analysieren, könnte vielmehr eines Tages zu den Aufgaben von speziell ausgebildeten Computern gehören.

In einer neuen Studie,

die in der Fachzeitschrift Cell veröffentlicht wurde, trainierten die Forscher Computer, indem sie ihnen Millionen Male aufeinanderfolgende Paare von fluoreszenzmarkierten und unmarkierten Bildern von Hirngewebe einspeisten [1]. Dies ermöglichte den Computern in den Bildern Muster zu erkennen, Regeln zu definieren und diese auf das Betrachten künftiger Bilder anzuwenden. Mit diesem Ansatz - dem sogenannten Deep Learning - zeigten die Forscher auf, dass die Computer nicht nur lernten einzelne Zellen erkennen, sondern auch eine fast übermenschliche Fähigkeit entwickelten den Zelltyp zu identifizieren und ob es sich um eine lebende oder tote Zelle handelte. Noch bemerkenswerter ist, dass die trainierten Computer all diese Aufgaben lösten ohne die in Zellstudien üblicherweise verwendeten aggressiven chemischen Färbungen, inklusive Fluoreszenzmarkierungen, zu benötigen.

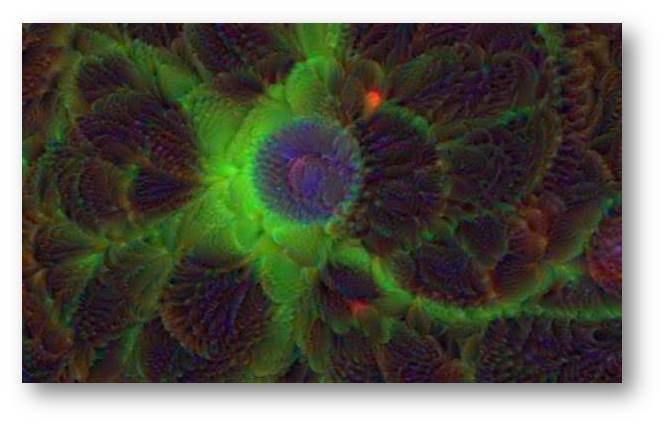

Mit anderen Worten, die Computer lernten, das Unsichtbare zu "sehen"! Abbildung 1.

Abbildung 1. Bei der Analyse von Gehirnzellen "denkt" ein Computerprogramm darüber nach, welche zelluläre Struktur identifiziert werden soll. Credit: Steven Finkbeiner, University of California, San Francisco and the Gladstone Institutes

Abbildung 1. Bei der Analyse von Gehirnzellen "denkt" ein Computerprogramm darüber nach, welche zelluläre Struktur identifiziert werden soll. Credit: Steven Finkbeiner, University of California, San Francisco and the Gladstone Institutes

Zusammenarbeit von Biologie und Künstlicher Intelligenz

Vor einigen Jahren zeigten sich Philip Nelson und Eric Christiansen von Google Accelerated Science (Mountain View, CA) - einem führenden Unternehmen im Gebiet der Künstlichen Intelligenz - daran interessiert, Maschinelles Lernen für eine Vielzahl von Anwendungen zu adaptieren. Sie hofften Algorithmen für Deep Learning zu entwickeln, um wichtige Probleme, auch in der Biologie, zu lösen. (In Bereichen vom Smartphone bis zum selbstfahrenden Auto sind Anwendungen von Deep Learning ja bereits allgemein bekannt.)

Damit Deep Learning aber funktioniert, sind enorm große Mengen an Trainingsdaten erforderlich. Das Google-Team erfuhr von Steven Finkbeiner (Professor an der University of California, San Francisco (UCSF) und Direktor der Gladstone-Institute), der - unterstützt von den NIH - das erste vollautomatische Roboter-Mikroskop namens Brain Bot entwickelt hatte [2]. Dieses Brain Bot kann bis über Monate hin Tausende einzelner Zellen verfolgen und dabei weit mehr informationsreiche Bilddaten liefern (3 - 5 Terabytes/Tag), als sein Labor vermutlich analysieren kann. Angesichts der Menge und Komplexität der Daten sah Finkbeiner imDeep Learning eine Möglichkeit seine Forschung um ansonsten für ihn nicht erkennbare Details zu erweitern.

Das Google-Team benötigte also ein biomedizinisches Projekt, das eine enorme Datenmenge generierte und trat nun an Finkbeiner heran, der Bedarf für Deep Learning hatte - so entstand eine Zusammenarbeit.

Deep Learning

In ihrer gemeinsamen Untersuchung [1] trainierten die Forscher nun zunächst einen Computer, indem sie ihm Bilder von zwei Sets von Zellen einspeisten. Eines der Sets war fluoreszenzmarkiert, um damit die für die Forscher interessanten Strukturen hervorzuheben, das andere Set war unmarkiert. Den Vorgang wiederholten sie dann Millionen Male, um ein Lernen des Computers zu generieren.

Beim Deep Learning sucht der Computer nach Mustern in den Daten. Während der Computer Bilder Pixel für Pixel durchscannt, beginnt er komplexe Zusammenhänge in einem Netzwerk zu "sehen", verstärkt darin einige Verbindungen und schwächt andere. Wenn der Computer nun weitere Bildpaare untersucht, beginnt er, basierend auf übereinstimmenden Mustern von markierten und unmarkierten Bildern, ein Netzwerk aufzubauen. Dies kann man damit vergleichen, wie die neuronalen Netzwerke unseres eigenen Gehirns Informationen verarbeiten, indem sie lernen sich auf einige Dinge zu konzentrieren, aber nicht auf andere.

Um den Computer zu testen, legten die Forscher ihm neue nicht markierte Bilder vor. Sie stellten fest, dass das neuronale Netzwerk des Computers einzelne Zellen identifizieren konnte, indem es lernte, den unmarkierten Zellkern zu erkennen. Schließlich konnte der Computer auch feststellen, welche Zellen lebendig oder tot waren - er konnte sogar inmitten lebender Zellen eine einzige tote Zelle herausfinden. Das ist etwas, wozu selbst Menschen nicht zuverlässig imstande sinf, auch wenn sie Tag für Tag über ihren Zellen brüten.

Der Computer konnte weiters auch Neuronen auswählen, die in einem Gemenge anderer Zelltypen vorlagen. Er konnte erkennen, ob eine neuronaler Fortsatz ein Axon ist (das Signale sendet) oder ein Dendrit (der eingehende Signale empfängt), obwohl diese beiden zellulären Anhängsel sehr ähnlich aussehen. Mit zunehmendem Wissen benötigte der Computer auch immer weniger Daten, um eine neue Aufgabe zu lernen.

Diese Ergebnisse bieten einen wichtigen Beweis für den proof of principle, den Ansatz, dass Computer so trainiert werden können, dass sie Menschen bei der Analyse von Zellen und anderen komplexen Bildern nicht nur ersetzen, sondern auch übertreffen. Es wird offensichtlich, dass in den Bildern deutlich mehr Informationen vorhanden sind, als das menschliche Auge erfasst.

Eine Revolution in der Biomedizin…

Finkbeiner sieht viele Bereiche, in denen er seine trainierten Computer agieren lassen kann:

Beispielsweise könnten Computer verwendet werden, um herauszufinden, welche Stammzellen für eine Transplantation am besten geeignet sind.

Basierend auf Bildern von Zellen in der Kulturschale könnten Computer in der Lage sein, Krankheiten zu diagnostizieren, zugrundeliegende Ursachen herauszufinden und zu behandeln, einschließlich Schizophrenie, Alzheimer-Krankheit oder Parkinson-Krankheit.

Computer könnten auch trainiert werden, um gesunde Zellen von kranken Zellen zu unterscheiden - diese Fähigkeit könnte eingesetzt werden, um vielversprechende Kandidaten für neue Arzneimittel zu identifizieren.

…und darüber hinaus

Während es noch genügend Spielraum gibt, um die Vorhersagefähigkeiten des Netzwerks zu erweitern und zu verbessern, ist es wichtig anzumerken, dass Deep Learning nicht nur auf Bilddaten beschränkt ist. Tatsächlich können die gleichen Prinzipien auf jede Art von reichlich vorhandener, gut annotierter Information angewendet werden, DNA-Daten miteingeschlossen.

Computer könnten aber auch trainiert werden, um Beziehungen zwischen unterschiedlichen Arten von Daten zu suchen: dies lässt auf Entdeckungen hoffen, die weit über das hinausgehen, was wir Menschen heute verstehen. Und: Computer werden nie müde oder beschweren sich über die Arbeitszeiten.

[1] In Silico Labeling: Predicting Fluorescent Labels in Unlabeled Images. Christiansen EM, Yang SJ, Ando DM, Javaherian A, Skibinski G, Lipnick S, Mount E, O’Neil A, Shah K, Lee AK, Goyal P, Fedus W, Poplin R, Esteva A, Berndl M, Rubin LL, Nelson P, Finkbeiner S. Cell. 2018 Apr 9. pii: S0092-8674(18)30364-7.

[2] Automated microscope system for determining factors that predict neuronal fate. Arrasate M, Finkbeiner S. Proc Natl Acad Sci U S A. 2005 Mar 8;102(10):3840-3845.

* Dieser Artikel von NIH Director Francis Collins, M.D., Ph.D. erschien unter dem Titel: " Teaching Computers to “See” the Invisible in Living Cells" zuerst (am 24. April 2018) im NIH Director’s Blog. Der Artikel wurde von der Redaktion möglichst wortgetreu aus dem Englischen übersetzt und geringfügig (mit Untertiteln) für den Blog adaptiert.

Reprinted (and translated by ScienceBlog) with kind permission from the National Institutes of Health (NIH).

Weiterführende Links

- Steve Finkbeiner (University of California, San Francisco and the Gladstone Institutes) https://gladstone.org/our-science/people/steve-finkbeiner

- Google Accelerated Science Team (Google, Inc., Mountain View, CA) https://research.google.com/teams/gas/

- Jürgen Schmidhuber: Vortrag „Künstliche Intelligenz wird alles ändern“ 2016, Video 49:17 min

Jürgen Schmidhuber, Scientific Director am Schweizer Forschungsinstitut für Künstliche Intelligenz IDSIA (Univ. Lugano & SUPSI) ist einer der weltweit bekanntesten Experten für künstliche Intelligenz. Standard YouTube Lizenz.

- Printer-friendly version

- Log in to post comments